Auteur : Jean-Pierre Péneau_

DOI : https://doi.org/10.48568/w0fa-6238

[Cet article est issu de la conférence introductive donnée par Jean-Pierre Péneau lors du colloque SCAN12 « Compléxité(s) des modèles de l’architecture numérique » de juin dernier. Ce texte est l’occasion pour JP Péneau de faire un retour sur les origines du CERMA (laboratoire CNRS de l’ENSA Nantes), mais aussi sur quelques notions clefs telles que la modélisation inverse et la complexité. Ce texte se poursuit dans un second article.]

Je dois tout d’abord bien vivement remercier les organisateurs de SCAN 12 qui me font l’honneur de prononcer cet exposé d’ouverture du colloque. Ils ont un indéniable goût du risque, tant l’appel aux personnes âgées conduit tout naturellement sur les voies de la rétrospective biographique. L’entame de mon propos ne va pas manquer d’éveiller leurs craintes et les vôtres.

Face à cette demande d’un discours introductif en matière de modélisation numérique et de complexité – ayant dûment formulé les protestations d’usage sur mon incompétence et mon manque de légitimité scientifique dans le domaine – je me suis, en effet, livré à un exercice de retour sur une trajectoire qui m’a vu confronté trés tôt aux questions d’architecture numérique. En ce registre qu’est-ce qui pouvait vraiment ressortir à cette question de la complexité ?

Peut-être un mot sur les débuts de mon engagement dans les applications informatiques …

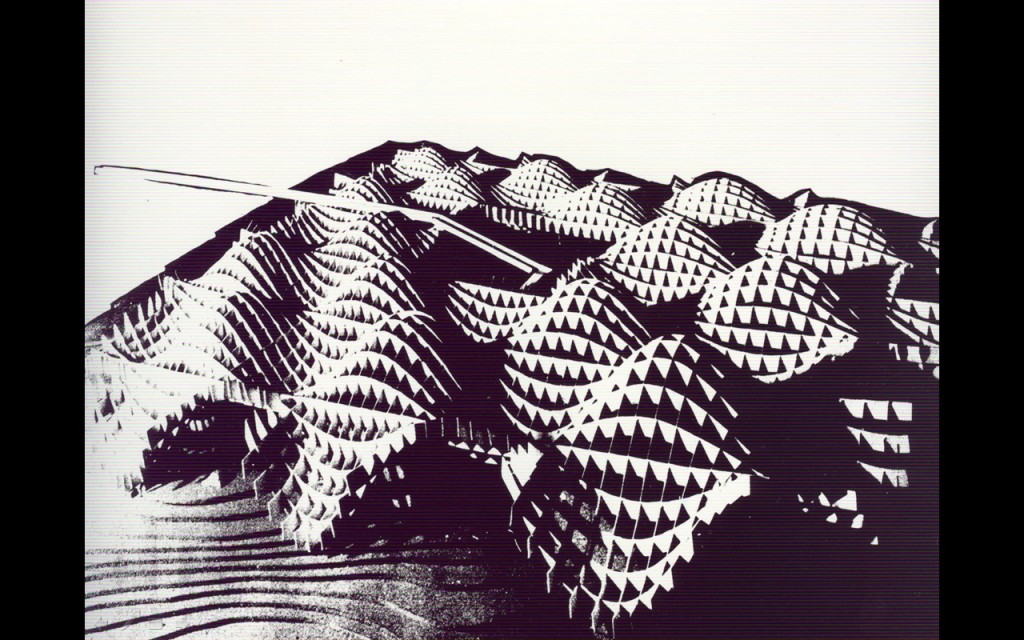

En phase terminale du système des Beaux-Arts, nous étions fascinés par la réflexion morphologique et structurale de D’Arcy Thompson relayée et développée notamment par Robert Le Ricolais. Nous restions non moins sidérés par les prodiges des automates projectuels de Christopher Alexander. Dans la salle Melpomène à la session de juin 1967 du Diplôme d’architecte, les 12 m2 de ma cimaise exhibaient un étrange édifice à structure non répétitive, fruit d’un calcul et d’un tracé numérique. Il relevait d’une posture un peu critique vis-à-vis de la mode des assemblages plus ou moins aléatoires de cellules identiques : formule très en vigueur du moment. En regard, les premières applications de machine à commandes numériques aux chantiers de constructions navales de Saint-Nazaire m’avaient laissé imaginer des possibilités de variations débridées. Tous les composants de ma structure régie par un pas logarithmique étaient différents. J’ignorais alors que cet objet relevait de la génération paramétrique et qu’il avait un caractère foncièrement non-standard. J’amorçais peu après, en 1971, un parcours de recherche, pour me colleter des années durant au traitement numérique des questions d’environnement ; au créneau du contrôle des facteurs climatiques et des questions énergétiques.

A nos débuts, l’ergonomie de ces procédures était laborieuse : les sorties graphiques appelaient le crayonnage manuel ou le collage de trames. Il avait fallu s’en contenter avant que nous soient affectées les premières machines de synthèse d’image de la firme grenobloise Getris-Images, pionnières françaises en la matière, et que l’on mette à notre disposition le logiciel IKO de Michel Bret.

Ainsi dotées, les équipes du CERMA ont progressivement développé un ensemble d’outils de modélisation et de simulation directe d’ensoleillement, d’éclairement, d’échanges thermiques, de propagation aéraulique. Ils sont devenus opérationnels dans de nombreuses situations applicatives, et au fil de nombreuses collaborations. Celle avec l’atelier Christian de Portzamparc pour le projet du quartier du Tripode en cours d’achèvement à Nantes en constitue une bonne illustration. Les bilans énergétiques des effets de la végétalisation pour le projet de la confluence à Lyon sont un autre exemple de ce chaînage de modèles assurant la simulation de la totalité des paramètres climatiques. Les travaux les plus récents explorent les possibilités en ces domaines de l’informatique nomade.

Les uns et les autres mettent en œuvre des méthodes de simulation directe, mais la voie de la modélisation inverse, au plus près des pratiques projectuelles a été également explorée.

La modélisation inverse

[La « modélisation inverse » permet de modéliser une ouverture à partir d’un objectif d’ensoleillement : c’est donc une modélisation « à l’inverse » de la modélisation traditionnelle où l’on commence par modéliser un espace pour ensuite en évaluer l’ensoleillement.]

Ce ne sont pas moins de 12 thèses qui ont été soutenues dans le cadre de programmes interdisciplinaires du CNRS et du pôle des sciences de la ville nantais depuis 1988 sur la question. La dernière soutenue en 2007 avait vu Vincent Tourre participer au premier SCAN [« SCAN’05 : Rôle de l’esquisse architecturale dans le monde numérique » à eu lieu à l’ENSA Paris Val de Seine en 2005] et présenter sa méthode inverse pour définir le percement correspondant à un effet lumineux illustré par un croquis.

Ingénieur de formation, Vincent Tourre a été recruté comme Maître de conférences en informatique à l’Ecole Centrale de Nantes et fait partie de l’équipe de recherche commune à cette école et au CERMA. Il a poursuivi ses recherches dans la même voie et a pu appliquer sa méthode inverse en collaboration avec les Ateliers Jean Nouvel pour la répartition des percements zénithaux du Louvres d’Abu Dhabi. Il donne dans un récent N° de L’IJAC [International Journal of Architectural Computing, Volume 8, n°4, décembre 2010] un compte-rendu de cette application faite en collaboration avec Francis Miguet. Elle permet de préciser la densité et la répartition des oculi du dôme, en fonction du niveau d’éclairement souhaité pour les différents locaux du musée.

Recalage à l’aune de la complexité

Mais on peut légitimement s’interroger sur le lien existant entre ce que je viens de présenter et la problématique de la pensée complexe. Pour cela rien de mieux qu’un retour aux autorités et aux bons auteurs. Nous avons le privilège de compter l’un d’eux dans le jury du prix SCAN 12 qui va être décerné par l’Académie d’architecture, que Jean-Louis Le Moigne : pionnier en la matière, en soit remercié. On lui doit dans ses ouvrages une généalogie précise de ce qu’il repère avec Herbert Simon comme trois générations des théories de la pensée complexe.

Les trois générations de théories de la complexité :

// La première prend appui sur les progrès de la théorie mathématique de la communication (Shannon, Weaver), théorie des automates et réseaux (de von Foerster, Wiener), la recherche opérationnelle.

// La seconde se nourrit aux progrès des sciences de la computation et sciences de l’ingénieur, des sciences de la gestion et de l’intelligence artificielle (Simon), des sciences des systèmes (von Bertalanffy), des théories de l’auto-organisation (von Neumann, Ashby), des dynamiques non-linéaires (Mandelbrot, Thom, Prigogine), enfin aux avancées de la biologie évolutionnaire (Monod, Maturana, Varela).

// La troisième enfin trouve ses fondements dans les développements des systèmes adaptatifs complexes : algorithmes génétiques (Holland), réseaux neuronaux (Kaufmann), automates cellulaires (Wolfram).

Edgar Morin de son côté établit une généalogie de la complexité en rappelant que le paradigme de la simplicité valorise l’objectivité, la certitude, l’explication causale, les données quantitatives sur le modèle de la physique classique du XVIIe au XIXe. A partir de la seconde moitié du XIXe, il souligne la mise au jour de trois classes de phénomènes apparemment désordonnés : 1- le principe d’entropie en thermodynamique, 2- la description de phénomènes de discontinuité en physique quantique, 3- la découverte du caractère catastrophique et explosif de situations cosmologiques.

Cette remise en question de la mécanique rationnelle, marque l’apparition de la complexité désorganisée.

Les problèmes soulevés par la biologie, la médecine, l’économie, la psychologie, les sciences politiques sont trop compliqués pour être interprétés par la mécanique rationnelle et pas suffisamment désordonnés pour être appréhendés à partir de la mécanique quantique. Warren Weaver (dans Science and complexity, 1948) avait déjà avancé qu’ils relevaient de la complexité organisée.

Ce qui est complexe appelle des traductions dans des langages formels et informels, ajoutant un niveau d’incertitude dans l’usage de la notion. Elle implique de nouveau rapport au savoir avec des représentations non-dualistes, non-hiérarchiques et non-linéaires.

Se dégagent alors les postures marquées par la multi référencialité, la transdisciplinarité, la critique des modes traditionnels d’organisation de la connaissance ; et par l’émergence d’approches transversales. Edgar Morin les caractérise ainsi :

… si nous essayons de penser le fait que nous sommes des êtres à la fois physiques, biologiques, sociaux, culturels, psychiques et spirituels, il est évident que la complexité est ce qui essaie de concevoir l’articulation, l’identité et la différence de tous ces aspects, alors que la pensée simplifiante, soit disjoints ces différents aspects, soit les unifie par une réduction mutilante. »

Edgar Morin , Science et pratique de la complexité, Colloque d’Aix-en–Provence 1984 (p. 80)

Mais en regard de ce courant de pensée et de cette posture méthodologique, il faut bien admettre que nos travaux de modélisation et de simulation s’inscrivaient à la confluence de la physique de l’environnement et de l’informatique et – si ce n’était la dette de cette dernière aux avancées en matière de mathématiques appliquées, de cybernétique et de logique – force est de constater qu’ils ne relevaient que très faiblement du paradigme de la complexité tel qu’il vient d’être évoqué.

Pour citer cet article

Jean-Pierre Péneau, « L’approche ambiantale : une complexité augmentée. Partie II », DNArchi, 17/10/2012, <http://dnarchi.fr/culture/lapproche-ambiantale-une-complexite-augmentee-partie-i/>